До недавнего времени камеры сотовых телефонов линейки Pixel и Nexus не представляли собой ничего особого, но разработчики Google внедрили новый механизм постобработки фотографий HDR+, благодаря которому они поднялись на первые позиции различных рейтингов. И если вам интересно узнать о том, как работает HDR+ и как активировать его на своем смартфоне, читайте далее.

Что такое обычный HDR

Чтобы понять принципы работы HDR+ для начала разберемся с обычным HDR.

Недостаточный охват динамического диапазона в следствии маленького размера матрицы — главный недостаток всех камер смартфонов. Для решения этой проблемы разработали алгоритм HDR (High-Dynamic Range), принцип работы которого заключается в накладывании друг на друга и объединении трех снимков: кадра со стандартным для данной сцены уровнем экспозиции, недоэкспонированного кадра, где четко видны лишь пересвеченные участки изначального снимка и переэкспонированного кадра, на котором видны только затемненные участки изначального снимка. В результате получается снимок с хорошей проработкой всех деталей. Этот метод можно назвать небольшой революцией в области фотографии смартфонов.

К недостаткам алгоритма HDR относятся: долгое время съемки, раздвоение движущихся в кадре объектов, а так же смазывание всей картинки даже при минимальном движении или тряске камеры.

Что такое HDR+

HDR+ (High-Dynamic Range + Low Noise) — это алгоритм, имеющий ряд выдающихся возможностей и при этом лишенный недостатков HDR. В отличии от HDR новый алгоритм HDR+ почти не боится тряски смартфона и движений в кадре. Кроме того этот алгоритм способен повышать качество цветопередачи, что крайне важно при плохом освещении и по краям кадра, вместе с этим он сильно расширяет динамический диапазон фотографии. Ну и наконец, алгоритм HDR+ способен устранять шумы практически без потери детализации.

Первым из смартфоном обладателем поддержки HDR+ в 2013 году стал Nexus 5. Обновление Android 4.4.2., которое принесло с собой поддержку режима HDR+, что в корне изменило качество ночных снимков. Яркость по всему полю кадра не особо конечно изменилась, но зато при сохранении мелких деталей практически исчезли шумы. Ну и конечно же, не могла не порадовать прекрасная передача цветов, резко отличившая снимки Nexus 5 от снимков других смартфонов того времени.

Nexus 5 + HDR+

История создания HDR+

История создания алгоритма творящего чудеса использующего обычные камеры Nexus и Pixel началась в 2011 году, когда глава компании Google X Себастьян Трун (Sebastian Thrun) решил подыскать камеру для очков дополненной реальности Google Glass. Он предъявлял очень жесткие требования к массе и габаритам. Размер матрицы камеры необходимо было сделать еще меньше, чем в смартфоне, что привело бы к появлению большого количества шумов на снимке. Поэтому было решено попробовать улучшить качество фотографии с помощью алгоритмов. Этим и занялся преподаватель факультета информатики Стэнфордского университета, эксперт в области вычислительной фотографии Марк Левой (Marc Levoy), который занимался технологией захвата и обработки изображений на базе программного обеспечения.

Команда Gcam, под управлением М. Левой, занялась изучением метода объединения нескольких снимков в один кадр (Image Fusion). Качество фотографий обработанных при помощи этого метода заметно улучшилось. Они становились более яркими и четкими, а количество шумов заметно уменьшалось.

Эта технология дебютировала в 2013 году в Google Glass. Затем, переименованная в HDR+, в этом же году появилась и в Nexus 5.

Еще один ночной снимок с Nexus 5

Как работает HDR+

Технология HDR+ — чрезвычайно сложная. Поэтому разбирать ее детально в рамках этой статьи мы не будем, но главный принцип работы рассмотрим.

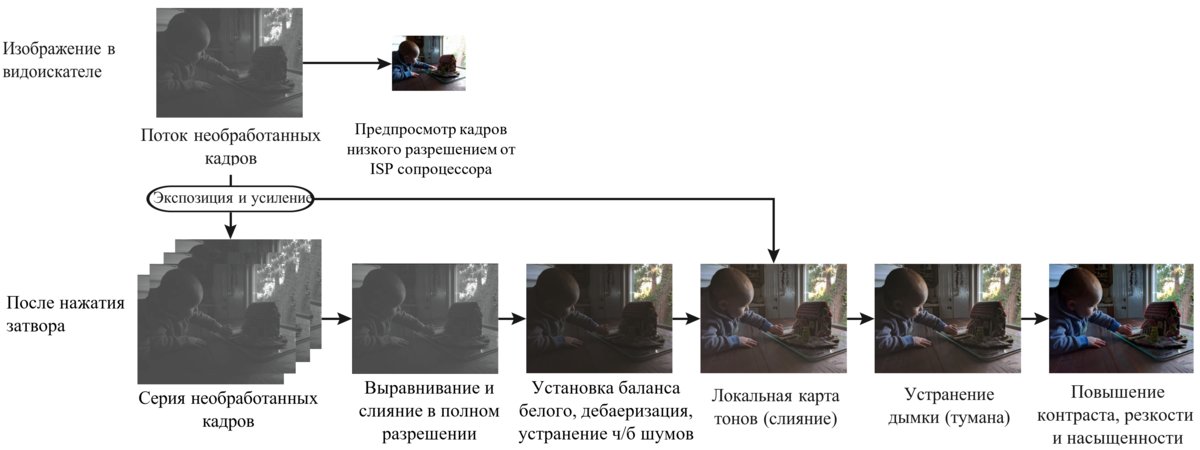

Основной принцип работы HDR+

Для сохранения максимального количества деталей на конечной фотографии После нажатия кнопки спуска затвора камера захватывает целую серию кадров с короткой выдержкой, т.е. недоэкспонированных снимков. Количество кадров зависит от уровня освещенности и количества деталей в тени. Затем вся серия снимков объединяется в один.

Благодаря заниженной выдержке каждая фотография в серии относительно четкая. Для основы используется самый лучший из первых трех кадров как по резкости, так и по детализации. После чего система разделяет все полученные кадры из этой серии на фрагменты и проверяет соседние фрагменты на совместимость. В случае обнаружения лишних предметов в одном из фрагментов, алгоритм удаляет этот фрагмент и выбирает похожий с другого кадра. Далее снимки обрабатываются с помощью специального алгоритма для уменьшения размытости изображений, который применяется в основном в астрофотографии.

РЕКОМЕНДУЕМ:

Как конвертировать HEIC в JPEG

Итак, использование короткой выдержки избавляет наши фотографии от пересвеченных мест, расширяя динамический диапазон снимка. Осталось только удалить шумы на темных участках специальным алгоритмом.

После этого фотография обрабатывается системой подавления шумов. Система включает в себя метод усреднения цвета пикселей на основе нескольких снимков и систему предсказания появления шумов. На границах переходов тона и смены текстуры цель «шумодава» минимизировать потерю детализации даже ценой наличия небольшого шума, но на участках с равномерной текстурой алгоритм выравнивает картинку почти до идеально равномерного тона и с великолепным сохранением переходов всех оттенков.

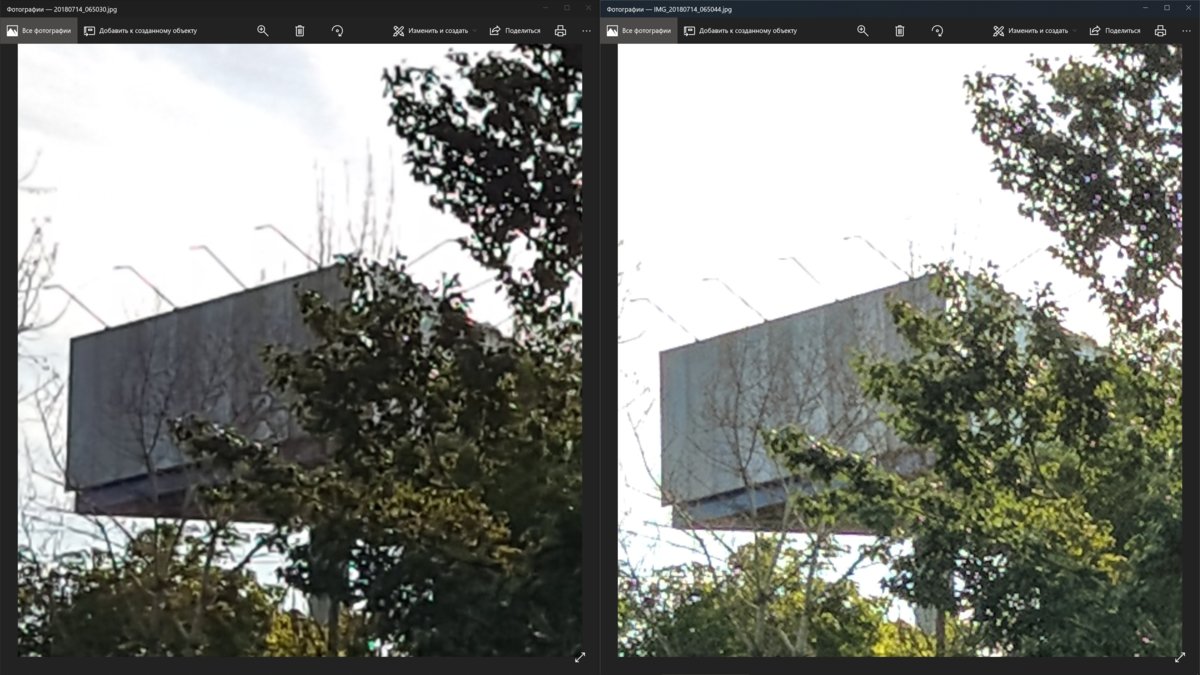

Работа шумодава в сложных условиях. Слева до обработки, а справа — после

И наконец выполняется постобработка полученного изображения. Алгоритм минимизирует частичное затемнение полученное в результате попаданием света под наклонным углом (виньетирование). Заменяет пиксели высококонтрастных краев на соседние (хроматическая аберрация). Оттенки зеленого делает более насыщенными, синие и пурпурные оттенки смещает в сторону голубого. Так же усиливает резкость (шарпинг) и делает другие операции значительно повышающие качество итоговой фотографии.

Конвейерный алгоритм HDR+ в работе.

Фотография, сделанная стоковой камерой Samsung в HDR, слева, а справа фотография, созданная в Gcam в HDR+. При сравнении этих двух фотографий бросается в глаза, что за счет потери детализации неба лучше прорисованы объекты на земле.

Отличие обновления HDR+ в Google Pixel

Технология ZSL (Zero Shutting Lag) была придумана для того, чтобы делать моментальные снимки. Смартфон сразу после запуска камеры снимает от 15 до 30 кадров в секунду в зависимости от степени освещенности. Pixel же решил использовать эту технологию для работы HDR+ по своему. При нажатии на кнопку спуска смартфон выбирает от 2 до 10 кадров из буфера ZSL. Затем из первых двух-трех кадров выбирается лучший, а остальные, как и в предыдущей версии алгоритма, слоями накладываются на основной.

Наряду с этим появилось разделение на два режима: HDR+ Auto и HDR+. Последний берет максимально большое количество снимков для создания итоговой фотографии. Она получается более сочной и яркой.

HDR+ Auto делает меньше фотографий, благодаря чему движущиеся объекты становятся менее размытыми, влияние тряски рук ниже, а фотография готова практически мгновенно после нажатия на кнопку съемки.

В версии Google Камеры для Pixel 2/2XL режим HDR+ Auto был переименован в HDR+ On, а HDR+ стал называться HDR+ Enhanced.

Во втором поколении Google Pixel появился специальный сопроцессор, называемый Pixel Visual Core. В настоящее время чип применяется только для ускоренной обработки фотографий в режиме HDR+, а также предоставляет сторонним приложениям возможность выполнять снимки в HDR+. На качестве фотографий, сделанных Google Камерой, его наличие или отсутствие никак не сказывается.

Google использует HDR+ даже для устранения проблем с железом. Из-за конструктивной ошибки Google Pixel / Pixel XL мог сделать фотографию с сильным засветом. Google выпустила обновление, которое использует HDR+, чтобы убрать этот засвет, комбинируя снимки.

Преимущества и недостатки HDR

Выделим основные достоинства HDR+:

- Алгоритм замечательно устраняет шумы с фотографий, практически не искажая детали.

- Цвета в темных сюжетах гораздо насыщеннее, чем при однокадровой съемке.

- Движущиеся объекты на снимках реже двоятся, чем при съемке в режиме HDR.

- Даже при создании кадра в условиях недостаточной освещенности вероятность смазывания картинки из-за дрожания камеры сведена к минимуму.

- Динамический диапазон шире, чем без использования HDR+.

- Цветопередача преимущественно получается естественней, чем при однокадровой съемке (не для всех смартфонов), особенно по углам снимка.

На ниже размещенных иллюстрациях слева расположена фотография со стоковой камеры Galaxy S7, а в правой части — фото в HDR+ через Google Камеру на том же устройстве.

Ночные фотографии города. Тут прекрасно видно, что HDR+ дает нам возможность получить отчетливое изображение группы граждан, расположившихся под вывеской Билайн. Небо выглядит чисто, дорожный знак отчетливо. Трава, как и должна быть, зеленая. Вывеска Билайн с правильной передачей цветов. Отчетливая прорисовка балконов, проводов и крон деревьев. Важно — проработка деталей на деревьях справа (в тени) у HDR+ несколько хуже, чем у стоковой камеры.

РЕКОМЕНДУЕМ:

Как открыть изображения RAW в Windows 10

Недостатков у HDR+ мало, да и носят они несущественный характер для большинства сюжетов. Во-первых, для создания HDR+ фотографии требуется много ресурсов процессора и оперативной памяти, что приводит к ряду негативных последствий:

- повышается расход аккумулятора, и устройство греется при объединении серии снимков;

- нельзя быстро сделать несколько снимков;

- мгновенный предпросмотр недоступен; фотография появится в галерее после окончания обработки, которая на Snapdragon 810 длится от до четырех секунд.

Частично эти проблемы уже решены с помощью Pixel Visual Core. Но этот сопроцессор, скорее всего, так и останется козырем Google Pixel.

Во-вторых, для работы алгоритму необходимо как минимум две фотографии, а в среднем происходит захват четырех-пяти кадров. Поэтому:

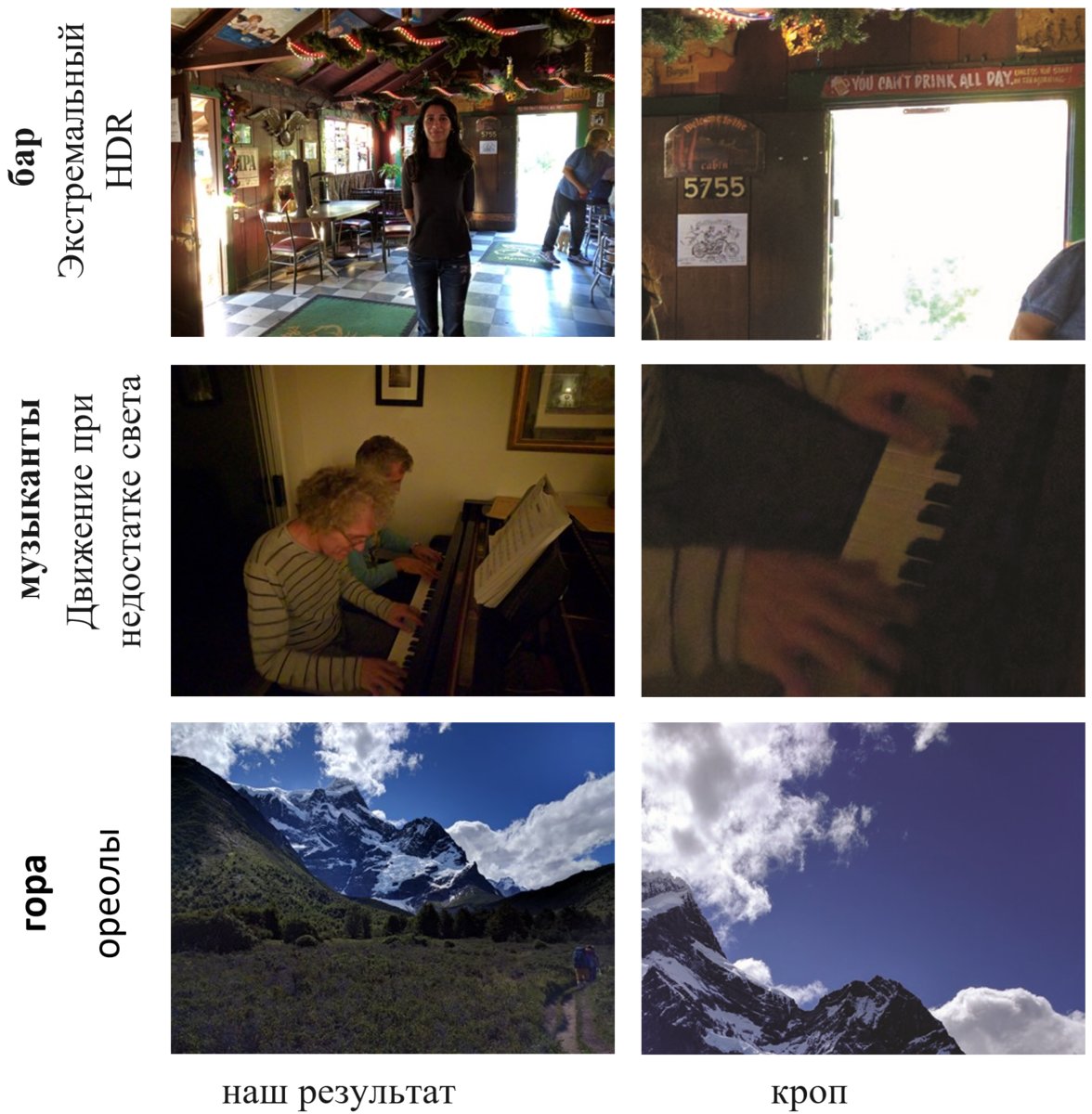

- обязательно возникнут ситуации, в которых алгоритмы будут давать сбои;

- HDR+ немного проигрывает классическому HDR по охвату динамического диапазона;

- создание одной фотографии и ее обработка с использованием быстрого ISP-сопроцессора будет предпочтительнее в экшен-сценах, потому что позволяет избежать двоения и смазывания объектов при невысокой выдержке.

Недостатки HDR+ из доклада его разработчиков

Ночная фотография с множеством движущихся объектов

На каких устройства работает HDR+

Чисто теоретически HDR+ может работать на любом смартфоне с версией Android не ниже 5.0 (необходим Camera2 API). Но по соображениям маркетинга, а также из-за наличия некоторых оптимизаций, требующих специальных железных компонентов (сопроцессор Hexagon в Snapdragon), Google намеренно заблокировала включение HDR+ на любом устройстве, кроме Pixel. Однако Android не был бы Android’ом, если бы энтузиасты не нашли способ обойти это ограничение.

В августе 2017 года один из пользователей 4PDA сумел модифицировать приложение Google Camera таким образом, чтобы режим HDR+ можно было использовать на любом смартфоне с сигнальным процессором Hexagon 680+ (Snapdragon 820+) и включенным Camera2 API. Первое время мод не поддерживал ZSL, да и в целом выглядел сыро. Но и этого было достаточно, чтобы улучшить качество фотосъемки смартфонов Xiaomi Mi5S, OnePlus 3 и прочих до ранее недостижимого для них уровня, а HTC U11 так и вовсе получил возможность на равных соревноваться с Google Pixel.

РЕКОМЕНДУЕМ:

Как изменить цвет выделения в Windows 10

Позже к адаптации Google Camera на телефоны сторонних вендоров подключились другие разработчики. Спустя некоторое время HDR+ заработал даже на устройствах со Snapdragon 808 и 810. На сегодняшний день практически для каждого смартфона, основанного на Snapdragon ARMv8, работающего на Android 7+ (в некоторых случаях и Android 6) и имеющего возможность использовать Camera2 API, существует портированная версия Google Camera. Частенько она поддерживается отдельным энтузиастом, но обычно таких разработчиков сразу несколько.

В начале января 2018 пользователь XDA miniuser123 сумел запустить Google Camera с HDR+ на своем Galaxy S7 с процессором Exynos. Немного позже выяснилось, что Google Camera работала также на Galaxy S8 и Note 8. Первые версии для Exynos были нестабильны, часто падали и зависали, в них не работала оптическая стабилизация изображения и ZSL. Версия 3.3 уже достаточно стабильна, поддерживает оптическую стабилизацию изображения и ZSL и все функции Google Camera, за исключением портретного режима. А в число поддерживаемых устройств теперь входят несколько смартфонов Samsung серии A.

Как включить HDR+ на телефоне

Если у вас смартфон на Exynos, то выбор невелик. Переходи в тему обсуждения на XDA, открывайте спойлер V8.3b Base (если у вас Android  или Pixe2Mod Base (для Android 7) и качайте последнюю версию. Также вы можете посетить группу в Telegram, где оперативно выкладывают все обновления Google Камеры.

или Pixe2Mod Base (для Android 7) и качайте последнюю версию. Также вы можете посетить группу в Telegram, где оперативно выкладывают все обновления Google Камеры.

Владельцам смартфонов с процессом Qualcomm придется поискать. Энтузиасты активно поддерживают версии Google Camera с HDR+ для множества смартфонов. Рекомендую погуглить и прогуляться по темам обсуждения камеры и самого устройства на таких форумах как XDA. Как минимум там будут пользователи, пытавшиеся запустить HDR+.

Ко всему вышесказанному упомяну, что в интернете есть страница, где собраны практически все версии Google Camera, на которой удобно тестировать различные Gcam на малоизвестных устройствах.

Заключение

Алгоритм HDR+ служит яркой демонстрацией возможностей мобильной цифровой фотографии. Пожалуй, на сегодняшний день это самый эффективный из доступных алгоритмов обработки изображений. HDR+ достаточно одного фотомодуля для создания снимка, по качеству обходящего двойные фотомодули некоторых гаджетов.